Un grand nombre d’entreprises se lancent soudainement dans le protocole de contexte de modèle. Qu’est-ce que c’est et que pouvez-vous en faire ?

En novembre 2024, Anthropic a rendu open source son protocole de contexte de modèle (MCP), « une norme pour connecter les assistants d’IA aux systèmes qui contiennent des données ». Depuis lors, de nombreuses entreprises utilisent le MCP pour permettre à leurs systèmes d’IA de consulter des sources locales et externes. Cela leur permet d’agir en tenant compte du contexte.

Dans cet article, nous expliquons plus en détail ce que signifie le MCP et ce qu’il fait exactement.

Protocole de contexte de modèle

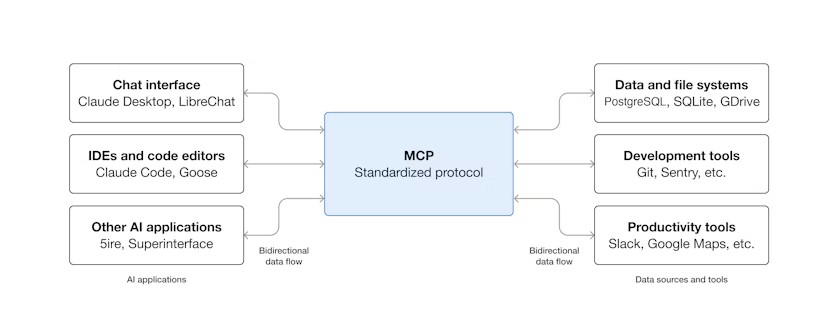

Le MCP est un protocole ouvert qui permet aux modèles d’IA de communiquer directement avec d’autres outils, bases de données et applications. Cela, sans qu’il soit nécessaire de créer une API distincte pour chaque intégration.

lire aussi

Anthropic lance un outil permettant de connecter directement les systèmes d’IA à des ensembles de données

Jusqu’à récemment, la plupart des systèmes d’IA fonctionnaient en grande partie en vase clos et donc avec les informations qu’ils recevaient via les données d’entraînement. Cela fonctionnait, mais ils ne pouvaient pas utiliser d’informations récentes. Le MCP change cela en étant une couche de connexion universelle entre l’IA et le monde extérieur.

Les entreprises d’IA populaires telles qu’OpenAI et Claude l’utilisent également déjà. Leurs modèles peuvent se connecter via MCP à des sources de données externes telles que des bases de données ou des fichiers locaux, des moteurs de recherche ou des invites spécialisées. Sur le site Web du MCP, le protocole est décrit comme « un port USB-C pour les applications d’IA ». Un port USB-C est une façon normalisée de connecter des appareils électroniques, le MCP connecte donc les applications d’IA à des systèmes externes.

Cela réduit considérablement les soucis des développeurs. Auparavant, ils devaient développer des intégrations via des API pour chaque outil ou source, et maintenant cela disparaît complètement. Cela fait de l’IA, et surtout des agents d’IA, non seulement des outils intelligents, mais aussi utiles. Cela signifie un développement plus rapide, moins de coûts et moins d’erreurs.

Ces avantages expliquent pourquoi tant d’entreprises se lancent soudainement dans cette voie. Au lieu d’adapter leur système d’IA à chaque fois à de nouveaux outils, ils peuvent désormais s’appuyer sur une seule architecture.

Comment cela fonctionne-t-il ?

L’architecture derrière le MCP est en fait toujours la même. Un hôte MCP, ou une application alimentée par l’IA telle que les agents de Claude ou ChatGPT, est connecté à un ou plusieurs serveurs MCP qui contiennent chacun une application ou une source différente. Certains serveurs peuvent accéder à des sources locales telles que des fichiers ou des bases de données, d’autres communiquent avec des API ou des services cloud en ligne. L’ensemble de ce processus relève du MCP

Un serveur MCP traduit une invite d’un utilisateur en une commande pour un outil particulier. Exemple : un serveur Otter MCP peut transcrire des enregistrements audio sur demande. Le serveur traite cette question, fournit un résultat et donne à l’IA le contexte nécessaire pour continuer à travailler avec la transcription.

Le MCP est-il unique ?

L’idée de donner aux systèmes d’IA l’accès à des données externes n’est pas nouvelle. Les développeurs essayaient depuis longtemps de donner aux modèles d’IA des informations provenant de l’extérieur. Ce qui rend le MCP différent, c’est qu’il s’agit d’une seule norme universelle offre une norme. Il brise la dépendance à certaines API et peut être utilisé par toutes sortes de systèmes.

Un agent Claude peut, par exemple, utiliser le même serveur MCP qu’un agent ChatGPT. Cela permet une collaboration à grande échelle.

Avantages et points d’attention

Les avantages du MCP résident principalement dans la collaboration. Des développeurs n’ont plus besoin d’écrire une intégration API distincte pour chaque application. Les entreprises peuvent mettre à disposition des données locales et basées sur le cloud via le même protocole pour leurs systèmes d’IA.

Cela facilite, par exemple :

- la recherche de documents internes sans partager de données sensibles en externe

- la combinaison de données provenant de différents systèmes dans un seul contexte

- permettre aux agents d’IA de travailler avec des informations à jour au lieu de connaissances statiques

Dans le même temps, il y a aussi des points d’attention. Étant donné que le MCP constitue un pont entre l’IA et les données d’entreprise sensibles, la sécurité et la gestion des accès restent essentielles. Les chercheurs ont déjà trouvé plusieurs vulnérabilités telles que l’injection d’invites ou l’exécution non autorisée de commandes.

Où en est le MCP maintenant

Le MCP est actuellement dans une phase précoce d’adoption. La norme est en cours de développement par Anthropic et la communauté open source. Les analystes estiment qu’il est fort probable que le MCP, ou une variante de celui-ci, devienne une norme pour l’intégration de l’IA. Si cela se produit, le paysage de l’IA changerait complètement, passant de chatbots fermés à des systèmes d’IA qui collaborent activement avec leurs logiciels et infrastructures de données existants.

Le protocole de contexte de modèle est une tentative de rationaliser le paysage croissant des intégrations d’IA. En introduisant une norme ouverte unique permettant aux modèles de langage de communiquer avec d’autres systèmes, le MCP réduit le seuil technique pour les entreprises afin de déployer l’IA.