L’entreprise d’IA Anthropic modifie en profondeur sa politique de confidentialité. Désormais, les données seront utilisées pour l’entraînement, sauf si vous vous y opposez .

Les utilisateurs de Claude doivent confirmer explicitement avant le 28 septembre si leurs conversations peuvent être utilisées pour entraîner des modèles d’IA. Dans le cas contraire, leurs données seront protégées. Quiconque ne fait rien, accepte automatiquement.

Données de conversation conservées pendant cinq ans

Jusqu’à présent, les conversations des utilisateurs gratuits et payants de Claude (comme Claude Pro et Claude Max) n’étaient pas utilisées pour l’entraînement. À partir de fin septembre, cette politique change : les conversations, y compris les instructions de codage, peuvent être utilisées pour améliorer les futurs systèmes d’IA. Les données des utilisateurs qui ne se désinscrivent pas seront conservées pendant cinq ans. C’est beaucoup plus long que les trente jours précédents.

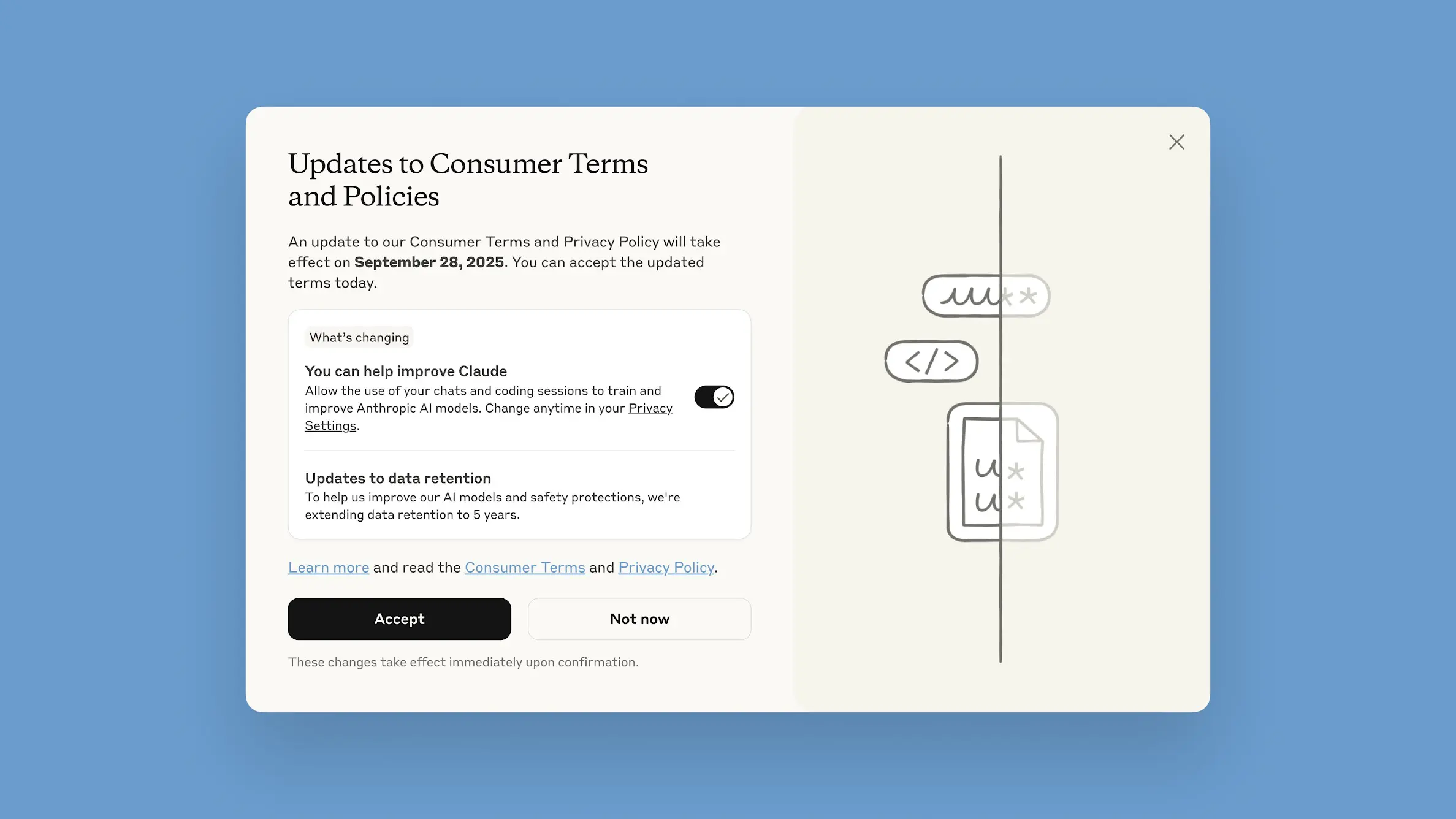

Quiconque crée un nouveau compte est directement invité à partager ou non les données d’entraînement. Les utilisateurs existants ne voient qu’une fenêtre contextuelle avec « Mises à jour de nos conditions d’utilisation » et un bouton « Accepter » bien visible. Le commutateur permettant d’accepter le partage de données est activé par défaut et, selon TechCrunch, est affiché de manière plus petite et plus subtile, ce qui peut prêter à confusion. Beaucoup de gens ne lisent pas les « petites lignes » avant d’accepter quelque chose.

Pression de la concurrence et actions en justice

Anthropic affirme que les utilisateurs contribuent à une « IA plus sûre et meilleure » s’ils partagent leurs conversations. Le besoin de données d’entraînement joue probablement un rôle majeur. Les entreprises d’IA telles que Anthropic, OpenAI et Google sont en forte concurrence et ont besoin d’énormes quantités d’informations réalistes. Pendant ce temps, le nombre de poursuites augmente : The New York Times a par exemple poursuivi OpenAI en relation avec la conservation des données.

Le choix appartient donc à l’utilisateur : consentir tacitement ou refuser explicitement. Mais choisir sans être vraiment bien informé devient de plus en plus difficile dans ce secteur en évolution rapide.

lire aussi