La start-up Taalas lance une puce de démonstration qui surpasse tous les accélérateurs d’IA existants avec une marge énorme en termes de vitesse. Cela est possible grâce à une approche nouvelle et plus économique, où le modèle d’IA est directement intégré au matériel.

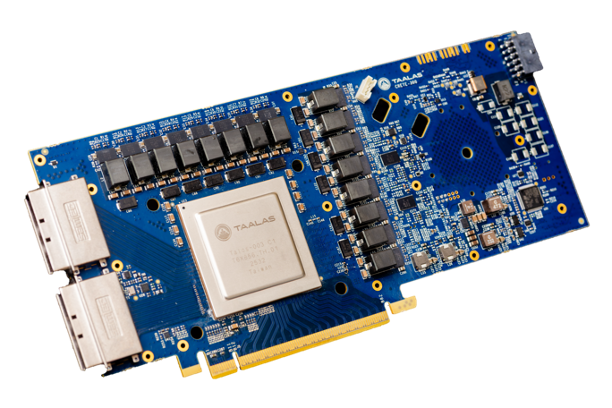

La start-up canadienne Taalas attire l’attention avec le lancement de la puce de démonstration Taalas HC1. Il s’agit d’un accélérateur d’IA pour l’inférence qui affiche des performances d’une catégorie totalement différente de celles des puces d’IA les plus rapides actuellement sur le marché.

Record de vitesse

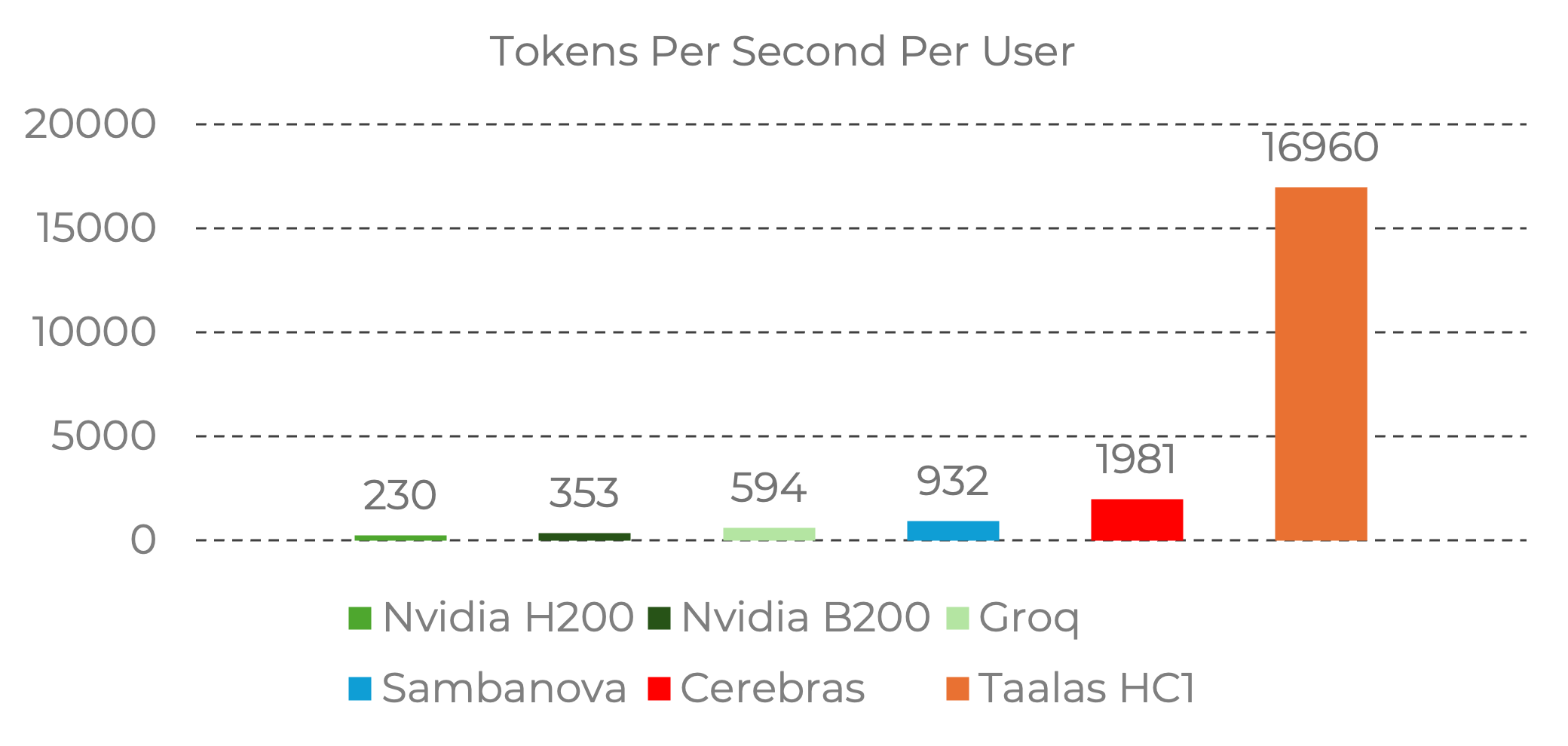

Le HC1 traite les requêtes à un peu moins de 17 000 tokens par seconde (16 960). Le Nvidia B200 s’en tient à 594 tokens par seconde. La puce d’IA la plus performante du moment, de Cerebras, est encore plus de huit fois plus lente avec 1 981 tokens par seconde.

Attention toutefois : ces chiffres proviennent de Taalas elle-même. Ils correspondent approximativement à ce qu’indique la concurrence, bien qu’il existe des scénarios et des modèles dans lesquels le Nvidia B200, par exemple, est plus performant. Les ordres de grandeur restent cependant corrects. De plus, le Taalas HC1 est considérablement moins cher. La puce de 53 milliards de transistors est gravée selon le procédé TSMC 6 nm, un peu plus ancien, et n’est pas encombrée de mémoire HBM coûteuse, contrairement aux autres accélérateurs.

LLM en tant que matériel vs logiciel

Cela est possible car Taalas a choisi une approche radicalement différente. En effet, vous ne pouvez pas charger vos propres LLM sur l’accélérateur HC1. Les ingénieurs de Taalas ont plutôt intégré un LLM de manière matérielle sur la puce elle-même. Dans ce modèle de démonstration, il s’agit de l’ancien modèle Llama 3.1 8B.

Taalas souligne qu’aujourd’hui, les modèles d’IA sont des logiciels et qu’à ce titre, ils exigent une puissance de calcul considérable. Ce constat ne sort pas de nulle part : les centres de données d’IA de plus en plus puissants des grandes entreprises du secteur mettent sous pression l’approvisionnement électrique disponible et ont extrêmement sollicité la chaîne d’approvisionnement des RAM et des SSD.

De plus, les investissements pour de tels centres de données s’élèvent à des dizaines de milliards, voire plus, ce qui fragilise le modèle économique de la consommation d’IA. Une voie réaliste vers un retour sur investissement à court terme se fait toujours attendre.

Les Canadiens estiment qu’il faut procéder autrement. Pour véritablement changer le monde grâce à l’IA, l’efficacité doit être multipliée par 1 000. Selon Taalas, cela ne peut se faire en exécutant des LLM comme des logiciels sur des systèmes généralistes. Le modèle ne doit pas être simulé sur un ordinateur traditionnel, mais devenir l’ordinateur lui-même.

Pas besoin de HBM

Le Taalas HC1 est une puce de démonstration de cette idée. Llama 3.1 8B n’est pas un modèle très volumineux, ce qui a motivé son choix pour la première itération du concept. Le modèle est intégré au niveau matériel dans l’accélérateur, ce qui élimine le goulot d’étranglement que constitue le pont entre la puce et la mémoire.

Par conséquent, le Taalas HC1 n’a pas besoin de mémoire HBM pour charger le LLM, ni de mise en pile 3D (3D-stacking) ou d’E/S spéciales. L’efficacité est multipliée par 10 et la génération de chaleur de la puce diminue, ce qui rend le refroidissement liquide facultatif.

Taalas a travaillé pendant deux ans et demi sur cette puce avec une équipe de 24 personnes et un budget d’à peine 30 millions de dollars. L’entreprise affirme pouvoir convertir un nouveau modèle en matériel sur une puce sur mesure en deux mois. Pour ce faire, elle a développé la Taalas Foundry. Le coût de production des puces serait 20 fois inférieur à celui des accélérateurs d’IA traditionnels.

Une réponse en un clin d’œil

Outre un coût réduit, tant opérationnel que de production, la vitesse est un atout immense du Taalas HC1. Taalas a lancé un chatbot en ligne (chatjimmy) qui permet d’en faire l’expérience par soi-même. Même les réponses les plus longues du chatbot apparaissent instantanément.

Nous avons ainsi demandé d’expliquer en environ 300 mots l’avantage d’une puce d’IA optimisée matériellement. Une réponse de 256 mots est apparue dès que nous avons appuyé sur Entrée. Taalas affiche une statistique sur la vitesse : notre requête a été traitée à 15 735 tok/s, ce qui a permis de générer la réponse en 0,031 seconde.

L’expérience classique du chat avec un LLM, où le texte est généré sous vos yeux, disparaît alors. On voit normalement les réponses plus longues s’afficher en temps réel. Avec des requêtes complexes, cela peut rapidement prendre quelques secondes ou plus.

L’IA qui parle

Pour une conversation écrite, un tel délai n’est pas encore une catastrophe, mais Taalas voit plus loin. De nombreuses applications d’IA exigent une faible latence. On pense d’abord aux conversations vocales. Si vous posez une question à un système d’IA, l’expérience est bien meilleure s’il n’y a pas de pause de cinq secondes avant la réponse.

Ce n’est pas parce que le modèle est intégré qu’il n’y a plus de flexibilité. Ainsi, vous pouvez encore ajuster des paramètres tels que la fenêtre de contexte via des LoRA (low rank adapters). Le RAG (retrieval augmented generation) reste également possible. Le composant RAG peut parfaitement fonctionner comme un logiciel au-dessus du LLM intégré à la puce.

Inconvénients

Il y a bien sûr des inconvénients. En intégrant le modèle, l’investissement dans une puce est indissociable d’un seul modèle. Compte tenu de l’évolution rapide du domaine de l’IA, c’est un point négatif sérieux. Un LLM peut être ultramoderne aujourd’hui mais devenir obsolète d’ici six mois.

La puce de test avec Llama 3.1 8B est certes un foudre de guerre, mais pas un génie. Le modèle, avec ses huit milliards de paramètres relativement modestes, ne peut rivaliser avec les grands LLM tels que GPT 5.2.

Sur mesure pour un cas d’utilisation ciblé

L’approche de Taalas exige donc que les clients conçoivent une analyse de rentabilisation liée à un seul modèle, ce modèle devant rester adéquat jusqu’à ce que l’investissement soit amorti. Ce n’est pas si absurde : les grands LLM font sensation par leurs capacités, mais les gains d’efficacité opérationnelle proviennent d’applications ciblées.

lire aussi

Nvidia présente Rubin et Vera : 5 fois plus d’inférence que Blackwell et son propre processeur

Si un LLM est assez intelligent pour soutenir la fonctionnalité d’un agent fréquemment utilisé dans un flux de travail bien défini, il n’y a pas de raison majeure de le modifier. Pour une analyse de rentabilisation mature et réfléchie, l’approche de Taalas offre un moyen d’intégrer l’inférence avec une efficacité maximale et donc un coût minimal.

La puce d’IA matérielle est également potentiellement très intéressante pour la robotique. L’accélérateur plus économe avec une latence négligeable ouvre de nouvelles portes. Pensez non seulement aux machines exotiques, mais aussi, par exemple, aux futures voitures.

Vers un modèle plus grand

Avant d’en arriver là, Taalas doit encore accomplir du travail. Le Taalas HC1 est un produit de démonstration. Au cours de cette année, Taalas prévoit de lancer une deuxième puce de démonstration, basée sur le HC1 mais avec un modèle intégré légèrement plus grand.

Ensuite viendra le gros du travail. Dans une deuxième génération de sa plateforme (HC2), Taalas prévoit d’appliquer sa technologie à un modèle frontier : un LLM moderne et de grande taille du niveau des GPT 5.2 et Opus 4.6 de ce monde.

Percée

Les chiffres ne mentent pas : avec une équipe, un temps et des ressources limités, Taalas a démontré avec succès qu’il existe une valeur ajoutée énorme dans les LLM codés matériellement. Ces puces-cerveaux excellent en efficacité, tant pour la production que pour l’utilisation. Cela est immédiatement évident avec le Taalas HC1 et la démo de chatbot associée.

Reste à voir si l’approche s’imposera à ce stade. Taalas doit encore démontrer que des modèles plus performants fonctionnent également de cette manière. Inversement, le marché doit devenir suffisamment mature pour lier en toute confiance des analyses de rentabilisation à un seul modèle.

Quoi qu’il en soit, le lancement du Taalas HC1 constitue une nouvelle percée importante dans le développement et la démocratisation de l’IA.